Kategorie: Nachrichten

Massentierhaltung und steigende Energiekosten – Ausweg gefunden?

Am 20. Februar 2026 wurde in Deutschland nach 30 Jahren erstmals wieder ein Ausbruch von Newcastle Disease in einer Putenmastanlage amtlich festgestellt. Das war nur der Auftakt einer Reihe von so genannten Ausbrüchen der auch als atypischen Geflügelpest bezeichneten ‚Tierseuche‘ bisher in Brandenburg und Bayern. Interessant sind die Umstände, die Fragen aufwerfen. Ähnlichkeiten mit anderen […]

Der Beitrag Massentierhaltung und steigende Energiekosten – Ausweg gefunden? erschien zuerst unter tkp.at.

Bentley Kiew erreicht dritten Platz unter den europäischen Händlern

Es ist gut, in Kriegszeiten ein ukrainischer Oligarch zu sein. Während der Irankrieg unsere Aufmerksamkeit fesselt, geht der Krieg in der Ukraine weiter und die EU verschiebt unsere Steuergelder dorthin. Hier eine Art der Verwendung unseres Geldes. Bentley Kiew wurde laut einer Ankündigung von Richard Leopold, Bentleys Regionaldirektor für Europa, vom März 2026 bei den […]

Der Beitrag Bentley Kiew erreicht dritten Platz unter den europäischen Händlern erschien zuerst unter tkp.at.

Französischer Aktivist geht juristisch gegen Pfizer-Chef Bourla vor – „Das ist der Kampf meines Lebens“

Der französische Aktivist Marc Doyer hat rechtliche Schritte gegen den Pfizer-Vorstandsvorsitzenden Albert Bourla angekündigt. Hintergrund sind nach eigenen Angaben gesundheitliche Folgen im Zusammenhang mit einer COVID-19-Impfung. Doyer bezeichnet das Verfahren als „den Kampf seines Lebens“.

Ausgangspunkt der aktuellen Debatte ist jedoch eine andere Nachricht: Die Stabschefin des Weißen Hauses, Susie Wiles, ist an Brustkrebs im Frühstadium erkrankt. Das gab US-Präsident Donald Trump über seine Plattform Truth Social bekannt. Wiles werde ihre Arbeit während der Behandlung fortsetzen.

Trump würdigte in seiner Mitteilung insbesondere ihre Belastbarkeit und ihr Engagement. „Ihre Stärke und ihr Einsatz, ihre Arbeit fortzusetzen, während sie sich in Behandlung befindet, sagen alles über sie aus“, schrieb er.

Wiles gilt als eine zentrale Figur im politischen Umfeld Trumps. Sie leitete dessen Wahlkampf im Jahr 2024 und wird als maßgebliche Strategin hinter seinem politischen Erfolg betrachtet.

Die Diagnose löste zahlreiche Unterstützungsbekundungen aus – auch aus der Wirtschaft. Unter anderem äußerte sich der Pfizer-CEO Albert Bourla und verwies auf die gesellschaftliche Bedeutung von Krebserkrankungen. Schätzungen zufolge sei etwa jeder dritte Amerikaner im Laufe seines Lebens betroffen. Bourla sprach Wiles seine Unterstützung aus und betonte zugleich das Engagement seines Unternehmens in der Krebsforschung.

Diese Stellungnahme führte jedoch auch zu kritischen Reaktionen. Marc Doyer, der sich für die Anerkennung möglicher Nebenwirkungen von Corona-Impfstoffen einsetzt, wandte sich in sozialen Medien direkt an Bourla. Dabei kündigte er an, rechtlich gegen den Pfizer-Chef vorzugehen.

Hello @AlbertBourla I am the courageous man of France who will bring you to justice. This is the fight of my life for all the victims’ families.@realDonaldTrump @verity_france https://t.co/5UvzAqY5bZ pic.twitter.com/lTBKreMJa0

— Marc Doyer (@Marc_Doyer) March 16, 2026

In einer Videobotschaft erläuterte Doyer seine Beweggründe. Er berichtet, dass sowohl er als auch seine Ehefrau gegen COVID-19 geimpft worden seien. Kurz darauf sei seine Frau schwer erkrankt. Nach seinen Angaben entwickelte sie die seltene und tödlich verlaufende Creutzfeldt-Jakob-Krankheit.

Auf Grundlage dieser Erfahrungen hat Doyer nach eigenen Angaben Klagen gegen Pfizer in den USA sowie in Deutschland eingereicht. Kürzlich sei dabei eine wichtige verfahrensrechtliche Entscheidung zu seinen Gunsten getroffen worden: Die beklagten Parteien, darunter Pfizer, müssen demnach weiterhin Teil des Verfahrens bleiben, bis ein endgültiges Urteil gefällt ist.

Doyer argumentiert zudem, dass sich durch diese Entwicklung die rechtliche Position von Klägern verändern könnte. Seiner Auffassung nach verschiebt sich die Beweislast stärker auf die beteiligten Pharmaunternehmen.

Darüber hinaus äußert er Kritik an den damaligen Rahmenbedingungen der Impfkampagne. Das verwendete Vakzin sei zum Zeitpunkt der Verabreichung noch in einer experimentellen Phase gewesen, so Doyer. Gleichzeitig wirft er staatlichen Stellen vor, die Öffentlichkeit unzureichend oder fehlerhaft informiert zu haben.

Die Vorwürfe sind schwerwiegend, eine abschließende gerichtliche Klärung steht jedoch noch aus.

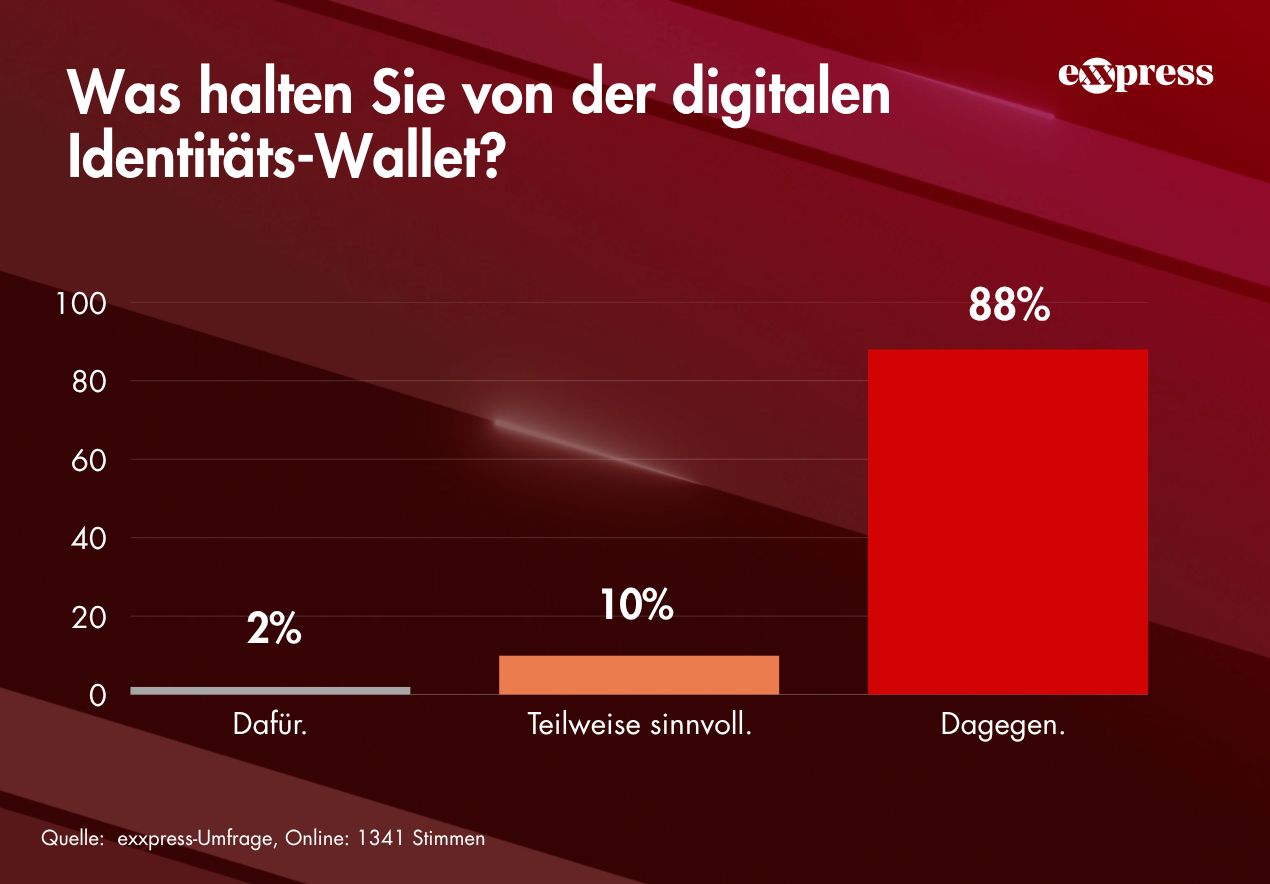

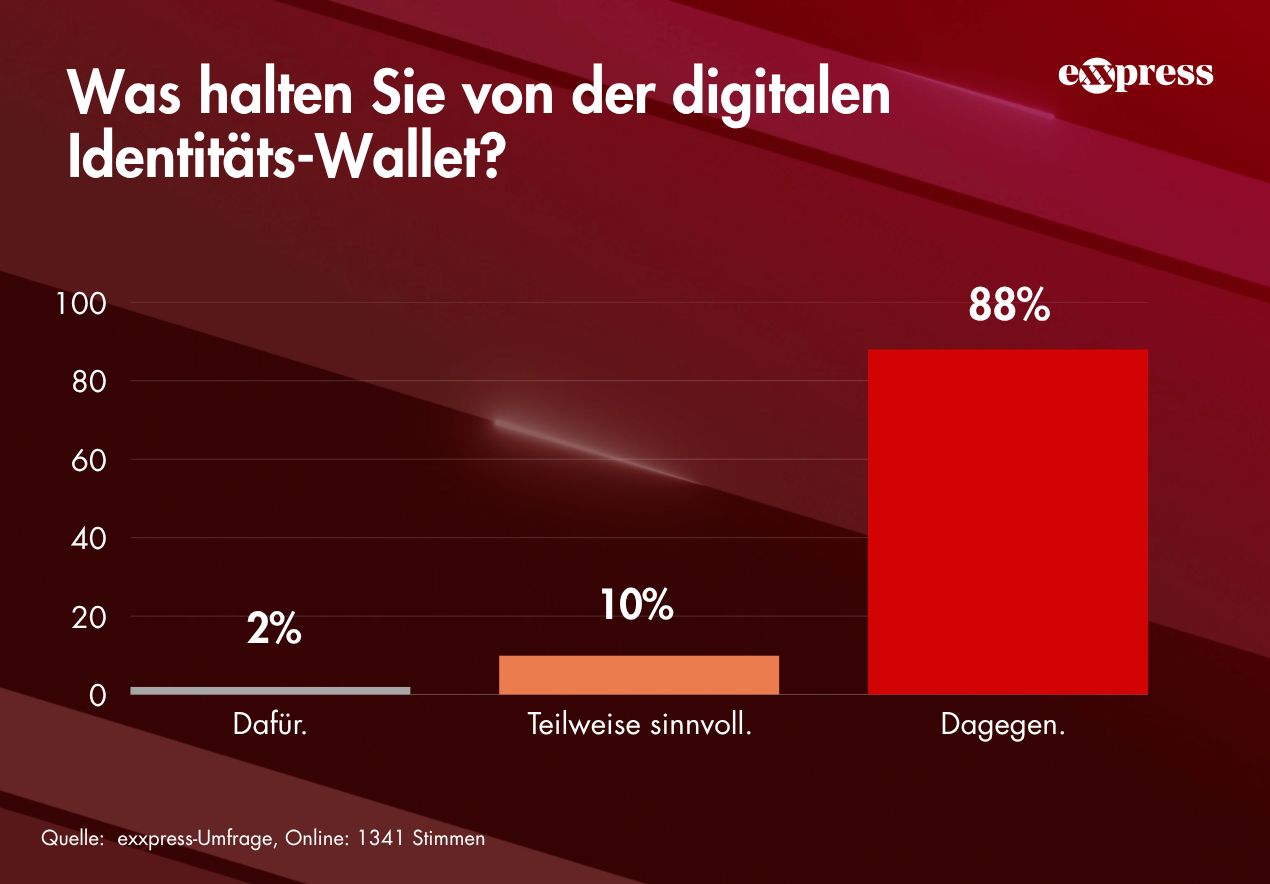

Digitale Identität: Brüssel stößt auf Widerstand – Bürger sagen Nein

exxpress schreibt: Eine Mehrheit der Bürger lehnt die geplante digitale Identität der EU ab.

Was in Brüssel als Meilenstein der Digitalisierung präsentiert wird, entwickelt sich zunehmend zu einem politischen Konfliktfeld: Die geplante digitale Identität stößt auf deutliche Ablehnung in der Bevölkerung.

Die Umfrage, über die exxpress berichtet, zeigt ein klares Bild. Während EU-Institutionen die Einführung der sogenannten „Digital Identity Wallet“ vorantreiben, wächst gleichzeitig die Skepsis gegenüber diesem Projekt.

Misstrauen statt Fortschrittsglaube

Offiziell soll die digitale Identität den Alltag erleichtern, Behördengänge digitalisieren und Dokumente bündeln.

Doch viele Bürger sehen darin vor allem ein System, das tief in persönliche Lebensbereiche eingreift. Die geplante Wallet vereint sensible Daten – von Ausweisen bis hin zu Gesundheitsinformationen – an einem zentralen Ort.

Für Kritiker ist das weniger ein Fortschritt als vielmehr ein potenzielles Risiko.

Der Kern der Kritik: Kontrolle und Datenmacht

Die Ablehnung beruht nicht primär auf Technikfeindlichkeit, sondern auf einem grundlegenden Vertrauensdefizit.

Im Zentrum stehen Fragen nach Zugriff, Nutzung und möglichem Missbrauch der Daten. Wer kontrolliert die Systeme? Wie werden Informationen verknüpft? Und welche Konsequenzen entstehen, wenn solche Strukturen erweitert werden?

Kritiker sehen in der digitalen Identität die Grundlage für eine Infrastruktur, die weit über reine Verwaltungsvereinfachung hinausgeht.

Wachsende Distanz zwischen Politik und Bevölkerung

Die Umfrage macht deutlich, dass sich die Wahrnehmung zwischen politischen Entscheidungsträgern und Bürgern zunehmend auseinanderentwickelt.

Während auf EU-Ebene zentrale digitale Systeme aufgebaut werden, entsteht bei vielen Menschen der Eindruck, dass diese Prozesse ohne ausreichende gesellschaftliche Debatte vorangetrieben werden.

Die digitale Identität steht damit exemplarisch für einen größeren Konflikt zwischen staatlicher Steuerung und individueller Selbstbestimmung.

Fazit

Die Ergebnisse zeigen: Die Zustimmung in der Bevölkerung fehlt.

Damit stellt sich nicht nur die Frage nach der technischen Umsetzung, sondern nach der politischen Legitimation eines der zentralen Digitalprojekte der Europäischen Union.

Journalist mit direkten Iran-Kontakten entlarvt aktuelles US-Narrativ – Teheran verschärft Kurs im Schatten widersprüchlicher Signale (Video)

Keine Gespräche, keine Kompromisse: Iran verschärft Kurs im Schatten widersprüchlicher US-Signale

Ein hochrangiger iranischer Beamter hat gegenüber den Journalisten Jeremy Scahill und Murtaza Hussin von Drop Site klargestellt: Es gebe keinerlei Verhandlungen zwischen Teheran und Washington. Die iranische Seite habe den Vereinigten Staaten lediglich ihre Bedingungen übermittelt – und selbst das ausschließlich indirekt über Drittstaaten.

Diese Darstellung steht in scharfem Kontrast zu den öffentlichen Aussagen aus Washington. Während US-Präsident Donald Trump von „produktiven Gesprächen“ und angeblichen Durchbrüchen spricht, zeichnen iranische Quellen ein völlig anderes Bild. Demnach wurden Botschaften der USA lediglich über Vermittlerstaaten wie die Türkei, Pakistan, Ägypten sowie mehrere Golfstaaten weitergeleitet.

Direkt zum Video mit deutschen Untertiteln:

Gleichzeitig eskaliert die Rhetorik aus dem Weißen Haus. Trump drohte öffentlich mit Angriffen auf die iranische Energie- und Strominfrastruktur – ein Schritt, der nach Einschätzung von Beobachtern einem Kriegsverbrechen gleichkäme, sollte er umfassend umgesetzt werden. Parallel dazu signalisierten dieselben US-Kanäle über Mittelsmänner angeblich Interesse an einem Ende des Krieges.

Teheran reagiert darauf mit demonstrativer Härte. Nach Angaben iranischer Quellen habe man jede direkte Kommunikation mit den USA verweigert. Selbst Kontaktversuche über den US-Sondergesandten Steve Witkoff seien ignoriert worden.

Die iranische Strategie ist klar: keine Gespräche ohne grundlegende Vorbedingungen. Sobald Drittstaaten als Vermittler auftreten und eine Gesprächsbereitschaft der USA signalisieren, übermittelt Teheran lediglich seine Forderungen – ohne in Verhandlungen einzutreten.

Diese Forderungen gehen weit über einen klassischen Waffenstillstand hinaus. Iran lehnt explizit jede Wiederholung früherer Vereinbarungen ab, wie sie nach dem sogenannten „Zwölf-Tage-Krieg“ im vergangenen Jahr getroffen wurden. Aus Sicht Teherans dienten solche Abkommen lediglich dazu, den USA und Israel Zeit zur militärischen Neuaufstellung zu verschaffen, bevor sie den Krieg erneut ausweiteten.

Stattdessen verlangt Iran eine umfassende Beendigung aller Kampfhandlungen – nicht nur auf eigenem Territorium, sondern auch in anderen Konfliktzonen wie Irak und Libanon. Dort seien israelische Streitkräfte zunehmend in direkte Gefechte verwickelt, während gleichzeitig intensive Bombardierungen stattfinden.

Zusätzlich fordert Teheran Reparationen – ausdrücklich von den Vereinigten Staaten, nicht von Israel. Die Begründung: Iran werde keine direkten Zahlungen aus Israel akzeptieren.

Besonders brisant ist die Haltung zum militärischen Kernprogramm. Iran schließt kategorisch aus, über sein ballistisches Raketenprogramm zu verhandeln. Dieses wird als zentrales Abschreckungsmittel gegen die USA und Israel betrachtet und soll im Falle eines Waffenstillstands umgehend weiter ausgebaut werden.

Noch weitreichender sind Hinweise auf eine strategische Neubewertung der Nuklearpolitik. Iran arbeitet laut den vorliegenden Informationen an einer neuen Doktrin, die über das bisherige Abkommen aus der Obama-Ära hinausgeht. Dabei könnten Kooperationen mit Russland und China eine Rolle spielen.

Diese Entwicklung deutet auf eine langfristige strategische Verschiebung hin. Während Washington öffentlich von Gesprächen spricht, scheint Teheran den Konflikt in eine neue Phase zu führen – weg von diplomatischen Manövern, hin zu klar definierten Machtpositionen.

Die Diskrepanz zwischen öffentlicher Darstellung und tatsächlicher Kommunikation zeigt dabei vor allem eines: Der Raum für echte Verhandlungen ist derzeit praktisch nicht existent. Stattdessen verläuft die Auseinandersetzung über indirekte Kanäle – und unter Bedingungen, die kaum Raum für Kompromisse lassen.

Pepe Escobar: Die infernalische Eskalationsmaschine

Pepe Escobar

Der Todeskult in Westasien greift South Pars an, Teil des größten Gasfeldes der Welt, das sich Iran mit Katars North Dome teilt. Dann greift er das Kernkraftwerk Natanz an.

Eine rote Linie nach der anderen wird nacheinander überschritten.

Die Architektur einer infernalischen Eskalationsmaschine – ohne Ausweg – ist unerbittlich.

Der Todeskult in Westasien greift South Pars an, Teil des größten Gasfeldes der Welt, das sich Iran mit Katars North Dome teilt. Dann greift er das Kernkraftwerk Natanz an.

Iran greift Dimona und Arad im Süden Israels an – nur 10 km vom nuklearen Forschungszentrum Negev entfernt.

Israel bombardiert Teheran weiterhin flächendeckend und greift erneut Isfahan an. Irans Energieminister bestätigt, dass „die lebenswichtige Wasser- und Strominfrastruktur des Landes schwere Schäden erlitten hat“, darunter „Dutzende Anlagen zur Wasserübertragung und -aufbereitung“ sowie „kritische Wasserversorgungsnetze“.

Neo-Caligula, im Zustand maximaler Hysterie, droht mit einem 48-Stunden-Ultimatum: Öffnet die Straße von Hormus bis Montagabend wieder, sonst werden die USA iranische Kraftwerke „angreifen und auslöschen“, „beginnend mit dem größten“.

Iran antwortet, dass Hormus „vollständig geschlossen“ wird, wenn Kraftwerke angegriffen werden. Parlamentspräsident Ghalibaf betont, dass sämtliche Energie- und Ölinfrastruktur im Persischen Golf zu „legitimen Zielen“ werde und „irreversibel zerstört“ werde. Betonung: „irreversibel“.

Diese Kolumne wurde geschrieben, während die Uhr tickt – früher Abend in Asien.

Die Prognosen von Goldman Sachs über Ölpreise zwischen 110 und 125 Dollar im April sind bereits irrelevant. Es wird eher in Richtung 200 gehen.

Während die Zeit weiterläuft, betont Iran erneut: Keine Kapitulation.

Stattdessen veröffentlicht Teheran fünf zentrale Bedingungen als Teil einer neuen strategischen rechtlichen Gleichung:

- Rechtsverbindliche Garantien, dass es keinen weiteren Krieg geben wird.

- Keine US-Militärbasen mehr in Westasien – innerhalb von 30 Tagen.

- Reparationen. In Höhe von 500 Milliarden Dollar.

- Keine weiteren Kriege gegen die Achse des Widerstands.

- Ein neues rechtliches Regime für die Straße von Hormus.

Dem gegenüber steht Barbarias Ziel, den Krieg „in wenigen Wochen“ zu beenden:

- Zerschlagung des iranischen Atomprogramms.

- Strenge Raketenbeschränkungen.

- Keine Unterstützung mehr für „Stellvertreter“ in Westasien.

Übersetzung: Kapitulation.

Ein Dekret des Pavians von Barbaria

Das Imperium des Chaos unter dem verwirrten Pavian sucht angeblich nach einem Ausweg, im TACO-Stil. Dessen Nichtexistenz ist ein kategorischer Imperativ (Kant-Spezialist Larijani könnte das erklären).

Wenn das Imperium zurückweicht, kollabiert der Petrodollar – das ist bereits im Gange – und die chihuahuaartigen Staaten des Persischen Golfs werden später als Klienten Irans absorbiert. Ganz zu schweigen davon, dass das mit 39 Billionen Dollar verschuldete Imperium des Chaos und der Plünderung selbst in einen bestätigten wirtschaftlichen Zusammenbruch stürzen wird.

Iran kann es sich schlicht nicht leisten, die Abschreckung zu schwächen, die es nun endgültig etabliert hat. Wenn das zivile Stromnetz angegriffen wird – was bereits vor Ablauf des Ultimatums geschehen ist –, muss die Antwort auf dieses Kriegsverbrechen und diese kollektive Bestrafung exemplarisch sein.

Zugzwang ist eingetreten. Wenn Neo-Caligulas Armada versucht, die Insel Kharg zu erobern, blockieren die Huthis Bab al-Mandab. Wenn Neo-Caligula gemäß seinem Ultimatum Irans Kraftwerke bombardiert, zerstört Iran die Energieinfrastruktur des Persischen Golfs.

Wenn diese beiden Bluffs nacheinander aufgerufen werden, ist der Weg frei für Schachmatt. Matt.

So wie es aussieht, könnte Neo-Caligulas Drohung zum ultimativen Beispiel des neuen Paradigmas werden: völlige Regel- und Gesetzlosigkeit im internationalen Chaos. Wenn ich dich nicht mag, bombardiere ich dich und töte dich.

All das wird durch das amerikanische politische und rechtliche System „legitimiert“: ein Kriegsverbrechen, im Voraus lautstark in einem Social-Media-Beitrag verkündet, einseitig, unter Umgehung jeglicher Checks and Balances, ohne Kontrolle durch den Kongress, ohne gerichtliche Prüfung, ohne gesellschaftliche Debatte. Ein Dekret des Pavians von Barbaria.

Iran verfügt über alles, was nötig ist, um seine Antwort auf diesen Wahnsinn zu kalibrieren – einen Wahnsinn, der gleichzeitig einen Absturz der globalen Energieversorgung, der Finanzmärkte und der Lieferketten für praktisch alles, was Menschen kaufen, auslösen könnte.

Parlamentspräsident Ghalibaf hat bereits eine klare Warnung ausgesprochen: Käufer von US-Staatsanleihen sind nun legitime Ziele. „Wir überwachen eure Portfolios.“ Er ermutigt im Wesentlichen die feigen GCC-Petromonarchien, ihre US-Staatsanleihen abzustoßen, um die Zielliste zu verlassen – das Äquivalent einer finanziellen Atombombe.

Iran hat bereits drei Amazon-Rechenzentren im Golf bombardiert. Als Nächstes stehen Google, Microsoft, Nvidia, Oracle und Palantir auf der Liste. Saudische und emiratische Staatsfonds müssen ernsthaft das hohe Risiko bedenken, US-Schulden zu halten. Das Imperium des Chaos muss massiv Kredite aufnehmen, um diesen ewigen Krieg zu finanzieren. Wenn die Renditen außer Kontrolle geraten, wird das unfinanzierbar.

Und dann, wie durch einen Zaubertrick, lief das Ultimatum von Neo-Caligula von selbst aus. Ein wahrhaft königlicher TACO.

Seine Tirade auf Truth Social wirkt wie eine komplette Fälschung. Sie enthält Aussagen wie „sehr gute und produktive Gespräche hinsichtlich einer vollständigen und endgültigen Lösung unserer Feindseligkeiten“. Das iranische Außenministerium war unmissverständlich: Es gab keine Gespräche. „Iran lehnt jegliche Gespräche ab, solange die Kriegsziele nicht erreicht sind.“

Oberflächlich betrachtet entschied Neo-Caligula, „alle militärischen Angriffe auf iranische Kraftwerke und Energieinfrastruktur um fünf Tage zu verschieben“.

Was tatsächlich passiert sein könnte: Iran hat über Oman Neo-Caligula übermittelt, dass es alle Karten in der Hand hält – und dass er allein verantwortlich sein wird, wenn er seine Drohung umsetzt und die Weltwirtschaft zum Einsturz bringt. Daraufhin setzte im Universum von Mar-a-Lago Verwirrung ein, während US-Staatsanleihen und Aktien bereits im Panikmodus waren, Angriffe auf iranische Kraftwerke bereits am frühen Montag stattfanden und Iran kurz davor stand, in der Nacht massiv zurückzuschlagen.

Die infernalische Eskalationsmaschine ist jedoch alles andere als unter Kontrolle. Bis in fünf Tagen.

Den Haag und Berlin: Zentrales Beratungsgremium warnt vor Einführung selbstvermehrender mRNA-Impfstoffe im Herbst

Alarmruf von Beratungsgremien über „selbstvermehrende“ mRNA-Impfung

Toine de Graaf

Sorgen um die Sicherheit für Mensch und Umwelt

Der Gesundheitsrat hat dem Minister für VWS in dieser Woche empfohlen, diesen Herbst und im Herbst 2027 Corona-Impfungen für Menschen über 70, medizinische Risikogruppen und Pflegekräfte anzubieten, die direkten Kontakt zu gefährdeten Patienten haben. Über die Arten der verfügbaren Impfstoffe sagt die Empfehlung nichts, aber auch die „selbstvermehrende“ mRNA-Impfung Kostaive gehört dazu. Die EU genehmigte diese im vergangenen Jahr, wobei eine Umwelt-Risikobewertung bewusst unterlassen wurde. Das staatliche Beratungsgremium Kommission für Genetische Modifikation (COGEM) und seine deutsche Schwesterorganisation sind besorgt über mögliche Risiken und plädierten bei der EU dennoch für eine solche Bewertung.

Eine der weniger bekannten staatlichen Beratungskommissionen der Niederlande ist die Kommission für Genetische Modifikation (COGEM), angesiedelt auf dem Gelände des RIVM in Bilthoven, deren Aufgaben im Umweltschutzgesetz festgelegt sind. Dieses unabhängige wissenschaftliche Gremium berät die Regierung (un)aufgefordert über mögliche Risiken für Mensch und Umwelt bei der Herstellung und beim Umgang mit genetisch veränderten Organismen (GVO). Ihr Arbeitsbereich umfasst die gesamte Biotechnologie, einschließlich medizinischer Anwendungen wie Impfstoffe auf Basis von GVO.

Die COGEM befasst sich daher auch mit den Corona-Impfungen, etwa mit dem „selbstvermehrenden“ Kostaive, für das die Europäische Kommission im Februar 2025 eine Marktzulassung für die Anwendung bei Erwachsenen ab 18 Jahren erteilte. Kostaive, auch bekannt als ARCT-154, wurde in Japan von Arcturus Therapeutics und Meiji Seika Pharma entwickelt und dort während der Herbstkampagne 2024 erstmals eingesetzt. Dies führte (inter)national zu einer Welle der Kritik aufgrund möglicher Risiken. Gewöhnliche mRNA-Impfstoffe besitzen eine Vermehrungsmethode: Aus einem RNA-Strang können mehrere Spike-Proteine produziert werden. Die selbstvermehrenden bzw. selbstreplizierenden mRNA-Impfstoffe basieren auf sogenannten self-amplifying mRNAs (samRNAs) und kopieren den Spike-Teil der RNA. Durch diesen zusätzlichen Vermehrungsschritt kann eine kleine Menge RNA eine größere Menge an Spike-Protein erzeugen.

Nach dieser europäischen Marktzulassung von Kostaive ergriff die COGEM gemeinsam mit ihrer deutschen „Schwesterkommission“ – der Zentralen Kommission für die Biologische Sicherheit (ZKBS) in Berlin – das Wort. In einem gemeinsamen offenen Brief an die Europäische Kommission im Mai des vergangenen Jahres äußerten sie ihre Bedenken hinsichtlich der Zulassung von Kostaive, da keine Umwelt-Risikobewertung durchgeführt worden war. Beide Kommissionen begründeten ihre Auffassung, dass eine angemessene Umwelt-Risikobewertung von Arzneimitteln auf Basis von „Replikonen“ wie samRNAs entscheidend sei. „Sowohl um die Risiken für Mensch und Umwelt von sich replizierenden Molekülen zu bewerten als auch um das Vertrauen und die Akzeptanz von Arzneimitteln zu gewährleisten, die mithilfe moderner Biotechnologie entwickelt wurden“, so die COGEM auf ihrer Website.

In dem gemeinsamen Brief wurden konkrete Risiken genannt, wie die mögliche Bildung rekombinanter Organismen und virusähnlicher Vesikel. Rekombination ist ein Prozess, bei dem genetisches Material (DNA oder RNA) ausgetauscht oder neu kombiniert wird, wodurch neue Genkombinationen entstehen. Virusähnliche Vesikel (VLVs) können sich „im Körper verbreiten, obwohl derzeit unklar ist, ob sie auch auf Dritte übertragen werden können“, warnten COGEM und ZKBS.

Welche der beiden Kommissionen die Initiative für den gemeinsamen Alarmruf nach Brüssel ergriffen hat, ist nicht bekannt. Es ist jedoch gut vorstellbar, dass dies die COGEM war. Diese Kommission hatte nämlich bereits im Juni 2024 dem damaligen Minister Harbers für Infrastruktur und Wasserwirtschaft einen besorgten Brief über einen Beschluss der Europäischen Kommission zum Status sogenannter „viraler Replikon-Partikel“ (VRPs) geschickt. Dabei handelt es sich um genetisch veränderte, virusähnliche Partikel, die sich in einer Wirtszelle selbst vermehren oder replizieren können. Die Europäische Kommission erklärte, dass diese VRPs keine GVO seien, wodurch bei Marktzulassungen für Anwendungen mit VRPs keine Umwelt-Risikobewertungen erforderlich seien. Die COGEM wies den Minister darauf hin, dass dieser EU-Beschluss „Unklarheiten aufwirft, eine wissenschaftliche und rechtliche Grundlage vermissen lässt und negative Auswirkungen auf die Sicherheit und die gesellschaftliche Akzeptanz hat“.

Für die COGEM war zu diesem Zeitpunkt noch unklar, ob die Europäische Kommission diese Argumentation auch auf andere Replikone wie samRNAs anwenden würde. Als Kostaive Anfang 2025 in der EU ohne vorherige Umwelt-Risikobewertung zugelassen wurde, bestand darüber kein Zweifel mehr, und es folgte der gemeinsame Brief mit der ZKBS. Die Europäische Kommission antwortete schließlich auf den Brief. Es war eine unbefriedigende Antwort für die niederländischen und deutschen Biotechnologiekommissionen, die Ende Januar ein weiteres Schreiben an die Europäische Kommission richteten, in dem sie erneut auf die Entwicklung spezifischer Leitlinien für Umwelt-Risikobewertungen medizinischer Anwendungen mit Replikonen wie samRNA-Impfstoffen drängten. Gleichzeitig informierte die COGEM das Ministerium für Infrastruktur und Wasserwirtschaft über den Schriftwechsel und schrieb: „Die Reaktion der Europäischen Kommission hat die Bedenken von COGEM und ZKBS hinsichtlich der Gewährleistung der Sicherheit für Mensch und Umwelt in keiner Weise ausräumen können.“

Die Europäische Kommission will keinen Millimeter nachgeben und hält Umwelt-Risikobewertungen bei selbstvermehrenden mRNA-Impfstoffen nicht für notwendig, im Gegensatz zu COGEM und ZKBS, die besorgt sind. Kritische Ärzte äußern seit Jahren ihre Bedenken hinsichtlich der Gesundheitsrisiken dieser neuen Generation von mRNA-Impfstoffen. „Die Gefahr dieser Innovation besteht darin, dass Probleme, die mit den mRNA-Impfstoffen verbunden sind, ebenfalls vervielfacht werden“, warnte das Ärzte-Kollektiv im Jahr 2024. „So wird beispielsweise die Dosierung noch schwieriger zu kontrollieren als bei den mRNA-Impfstoffen ohnehin schon. Außerdem scheint es wenig Kontrolle darüber zu geben, wo die Vermehrung stattfindet, wenn der Impfstoff die Injektionsstelle verlässt, was in der Regel in mehr oder weniger starkem Maße der Fall ist. Drittens stellt sich die Frage, wie lange das Spike-Protein im Körper produziert wird. Bei den aktuellen mRNA-Impfstoffen ist dies bereits viel länger als ursprünglich angenommen, und mit einem zusätzlichen Vermehrungsschritt könnte dies noch deutlich länger dauern.“

Im Vereinigten Königreich wurde Kostaive – unter dem Namen Zapomeran – im vergangenen Januar als Booster für Erwachsene zugelassen. Damit schloss sich das Land Japan und der EU an. In den USA wartet Kostaive weiterhin auf eine Marktzulassung. Solange Kennedy dort Gesundheitsminister ist, ist eine Änderung dieses Status nicht zu erwarten. Als die Europäische Kommission vor einem Jahr der innovativen mRNA-Impfung den roten Teppich ausrollte, äußerten Unterstützer Kennedys gegenüber dem Nachrichtenmedium The Defender scharfe Kritik. So bezeichnete Karl Jablonowski, leitender Forscher bei der von Kennedy gegründeten Organisation Children’s Health Defense, die Technologie als „besorgniserregend“, da sich das mRNA unbegrenzt vervielfältige. Seiner Ansicht nach komme dies „einer täglichen Impfung für den Rest des Lebens“ gleich. Dennoch arbeiten weltweit mehrere Unternehmen an der Entwicklung von samRNA-Impfstoffen.

Wie man die Straße von Hormus öffnet

Jacob G. Hornberger

Es gibt einen todsicheren Weg, den Iran zur Öffnung der Straße von Hormus zu bewegen. Hier ist er:

Präsident Trump gibt öffentlich folgende Erklärung ab:

1. Ich ordne heute den Abzug aller US-Truppen, Schiffe, Flugzeuge und Waffen aus dem Nahen Osten und deren Rückführung in die Vereinigten Staaten an. Ich weise das Pentagon außerdem an, diese Truppen in den Privatsektor zu entlassen, da sie nicht mehr benötigt werden. Unmittelbar im Anschluss daran folgt der Abzug der US-Truppen aus allen anderen Teilen der Welt und deren Entlassung in den Privatsektor.

2. Ich erkläre hiermit, dass es, solange ich Präsident bin, keine weiteren US-Militärangriffe oder Angriffskriege gegen den Iran oder irgendeine andere Nation geben wird.

3. Ich ordne hiermit die Aufhebung aller Wirtschaftssanktionen, Embargos und Blockaden gegen den Iran und alle anderen Nationen der Welt an.

4. Hiermit erkläre ich das Ende aller staatlich geförderten Attentate der USA.

5. Hiermit erkläre ich das Ende der Einmischung der US-Regierung in die Angelegenheiten anderer Nationen, einschließlich Staatsstreichen, Bündnissen mit diktatorischen Regimen, Bestechung ausländischer Regierungen und parteipolitischer Wahlkampfaktivitäten in anderen Ländern.

6. Ich fordere den Kongress auf, ein Gesetz zu erlassen, das jegliche Auslandshilfe an die israelische Regierung und alle anderen ausländischen Regierungen beendet.

7. Hiermit erkläre ich das Ende der langjährigen Unterordnung der US-Regierung unter die israelische Regierung.

8. Ich fordere den Kongress auf, die notwendigen Gesetze zum Abbau der nationalen Sicherheitsstaatsstruktur der USA aus der Zeit des Kalten Krieges zu erlassen, einschließlich des Pentagons, des riesigen militärisch-industriellen Komplexes, der CIA und der NSA, und zur Wiederherstellung des Gründungssystems der USA als Republik mit begrenzter Regierung und einer vergleichsweise kleinen Streitmacht.

9. Martin Luther King bezeichnete die US-Regierung als den größten Gewalttäter der Welt. Er hatte natürlich Recht. Es ist an der Zeit, diesem schändlichen „Erfolg“ ein Ende zu setzen.

10. Vor über 50 Jahren versuchte Präsident Kennedy, Amerika in eine andere Richtung zu lenken als die, die vom US-amerikanischen Sicherheitsapparat gewünscht wurde. Er scheiterte mit diesem Vorhaben und bezahlte dafür mit seinem Leben. Es ist nun notwendig, Kennedys mutigen Akt zu wiederholen, und ich, Donald Trump, der ich seit langem geschworen habe, den „Sumpf trockenzulegen“ und den „tiefen Staat“ zu zerschlagen, bin der Präsident, der dies tun wird, ungeachtet der Gefahren für mich. Es ist an der Zeit, die Vereinigten Staaten von Amerika wieder auf den Weg zu Freiheit, Frieden, Wohlstand und Harmonie mit den Völkern der Welt zu führen. Die Zerschlagung des US-amerikanischen Sicherheitsapparats und die Beendigung seiner Politik des Auslandsinterventionismus sind notwendige Schritte in diese Richtung.

Es versteht sich von selbst, dass der Iran Trumps Ankündigung angesichts der langen Geschichte von Lügen seitens der US-Regierung möglicherweise nicht glauben wird. Sobald Trump jedoch konkrete Schritte in diese andere Richtung unternimmt, werden iranische Offizielle schnell erkennen, dass er es ernst meint. Sobald sie sehen, dass die US-Regierung den Iran endlich – endlich! – in Ruhe lässt, ist es so gut wie sicher, dass sie die Straße von Hormus umgehend wieder öffnen werden.

Palantir-CEO stellt düstere Prognose für die Demokraten in Bezug auf KI

Von Tyler Durden

Alex Karp, CEO von Palantir, richtete eine apokalyptische Warnung an die Progressiven, insbesondere an „hochgebildete, oft weibliche Wähler, die überwiegend die Demokraten wählen“, und erklärte, dassihr Einfluss auf die Wirtschaft und die Gesellschaft insgesamt schwinden werde, da Technologien wie künstliche Intelligenz die Macht auf Männer aus der Arbeiterklasse mit rechtsgerichteten Ansichten übertragen würden.

„Diese Technologie bringt die geisteswissenschaftlich ausgebildeten, überwiegend demokratischen Wähler aus dem Gleichgewicht und schwächt ihre wirtschaftliche Macht. Und sie stärkt die wirtschaftliche Macht der beruflich ausgebildeten, oft männlichen Wähler aus der Arbeiterklasse“, sagte Karp am Donnerstag gegenüber den Moderatoren von CNBC.

Er fuhr fort: „Und so werden diese Umwälzungen jeden Aspekt unserer Gesellschaft erschüttern. Damit das funktioniert, müssen wir uns darauf einigen, was wir mit dieser Technologie anfangen wollen; wie wir es den Menschen erklären, die wahrscheinlich weniger gute und weniger interessante Jobs haben werden.“

Karp, dessen Softwareunternehmen Überwachungs- und Verteidigungsprodukte für die US-Regierung entwickelt, sagt im Wesentlichen, dass KI die wirtschaftliche Macht von hochgebildeten, sogenannten „woke Karens“ weg und hin zu männlichen Wählern aus der Arbeiterklasse, die oft rechtsgerichtet sind, verlagern wird.

Anschließend lenkte er das Gespräch auf militärische Anwendungen von KI, wobei er zugab, dass diese Technologien „gefährlich“ seien, gleichzeitig aber behauptete, dass Palantir eine amerikanische Zukunft ermöglichen werde.

„Diese Technologien sind gesellschaftlich gefährlich“, sagte Karp und fügte hinzu: „Die einzige Rechtfertigung, die man möglicherweise haben könnte, wäre, dass, wenn wir es nicht tun, unsere Gegner es tun werden. Und wir werden ihrer Rechtsordnung unterworfen sein… Warum nehmen wir das Risiko auf uns, das Gefüge unserer Gesellschaft, einschließlich ihrer mächtigsten Teile, zu zerstören, wenn es nicht darum geht, unsere Fähigkeit, Amerikaner zu sein, kurz- und langfristig zu bewahren?“

The CEO of Palantir just said the quiet part out loud.

Alex Karp — whose company builds surveillance and defense technology for the U.S. government — just openly stated that AI will deliberately shift economic power away from highly educated, often female, Democratic-leaning… pic.twitter.com/mqznkz4V90— Brian Allen (@allenanalysis) March 12, 2026

Übersetzung von „X“: Der CEO von Palantir hat gerade das ausgesprochen, was sonst nur hinter vorgehaltener Hand gemunkelt wird. Alex Karp – dessen Unternehmen Überwachungs- und Verteidigungstechnologie für die US-Regierung entwickelt – hat offen erklärt, dass KI die wirtschaftliche Macht bewusst von hochgebildeten, oft weiblichen, demokratisch orientierten Arbeitnehmern weg und hin zu beruflich ausgebildeten Wählern aus der Arbeiterklasse, die oft männlich sind, verlagern wird. Er gab dann zu, dass diese Technologien – wie er es ausdrückte – „gefährlich“ und „selbstmörderisch“ sind und dass die einzige Rechtfertigung für ihren Einsatz das militärische Argument ist: Wenn wir es nicht tun, werden es unsere Gegner tun. Lassen Sie uns also klarstellen, was soeben öffentlich gesagt wurde: Der CEO eines Rüstungsunternehmens hat Ihnen erklärt, dass KI entwickelt wird, um das amerikanische Klassensystem umzustrukturieren, dass sie die wirtschaftliche Macht einer ganzen politischen Bevölkerungsgruppe zerstören wird und dass der einzige Weg, dies der Öffentlichkeit zu verkaufen, darin besteht, es mit nationaler Sicherheit zu verpacken.

Karp vertritt die Ansicht, dass KI das amerikanische Klassensystem umgestalten und das wirtschaftliche Kräfteverhältnis verschieben wird. Das ist eine Möglichkeit, dem Durchschnittsbürger das Thema KI näherzubringen.

Iranische Raketen können Deutschland erreichen, aber kaum Berichte in den Medien

VERTUSCHT & VERSCHWIEGEN! »Hungermassenmorde« gegen deutsche Zivilisten im 1. Weltkrieg! (1)

NiUS-LIVE: So plant Merz Steuererhöhungen

Jeden Morgen von 6 bis 9 Uhr beleuchtet NiUS-LIVE die Themen, die Millionen Menschen bewegen und über die Deutschland spricht. Am Dienstag begrüßt Moderator Alex Purrucker den NiUS-Kolumnist Alexander Kissler und -Politikchef Ralf Schuler im Studio. Die Themen:

So plant Merz Steuererhöhungen

Friedrich Merz plant Steuererhöhungen für Besserverdiener. Der CDU-Chef, der einst als „Wirtschafts-Weise“ verkauft wurde, entpuppt sich als Steuer-Räuber. Statt den Mittelstand zu entlasten, will er die Leistungsträger noch stärker schröpfen. Während Rentner und Bürgergeld-Empfänger weiter kassieren, sollen diejenigen bluten, die Deutschland am Laufen halten. Klassenkampf von oben – typisch Union 2026.

Der Verdoppler: AfD-Chef Jan Bollinger live zu den Wahlen in Rheinland-Pfalz

Während die Altparteien noch über „Brandmauern“ faseln, verdoppelt die AfD in Rheinland-Pfalz ihre Stimmen – weil sie ausspricht, was 80 Prozent denken: Grenzen dicht, Remigration, Deutschland zuerst. Live zu Gast in der Sendung ist der AfD-Spitzenkandidat Jan Bollinger.

Von unseren Zwangs-Gebühren: Dunya-Hayali-Spielfilm ruft zur Denunziation auf

Bürger sollen Nachbarn anschwärzen, wenn diese „falsch“ denken. Mit unseren Zwangsgebühren finanziert der ZDF-Staatssender also Stasi 2.0. Während echte Verbrechen ungesühnt bleiben, hetzt die rot-grüne Propaganda-Maschine gegen das eigene Volk.

Kostet Sprit Ostern drei Euro? Ölpreis sinkt nur leicht

Ostern stehen die ersten Staus vor der Tür – und viele Normalbürger fragen sich: Schaffen wir die Fahrt zu Oma noch, oder wird der Tank zum Luxus? Die Regierung jubelt über „sinkende Preise“ – vergisst aber zu erwähnen: CO?-Steuer, Energiesteuer und 19 Prozent MwSt. fressen jeden Cent, den der Weltmarkt hergibt. Ideologischer Irrsinn sorgt dafür, dass der Autofahrer weiter zahlt.

The post NiUS-LIVE: So plant Merz Steuererhöhungen appeared first on PI-NEWS.