Von James Corbett

Erinnern Sie sich noch daran, als Buzzfeed 2018 der Welt auf dramatische Weise das Konzept des „Deepfakes” vorstellte?

Jordan Peeles Mund auf Barack Obamas Gesicht? Die Software „FakeApp“? Die beruhigende Versicherung, dass „alles, was man braucht [um einen Deepfake zu erkennen], ein bisschen Geduld und Skepsis ist“? Rückblickend wirkt alles an Buzzfeeds Deepfake-Warnung kurios.

So albern sie auch gewesen sein mag – laut Angaben waren 56 Stunden Videobearbeitung und die Aufsicht eines Videoeffekt-Profis nötig, um dieses wenig überzeugende Video zusammenzustellen –, die Warnung selbst war durchaus berechtigt. Wie sich herausstellte, hatte Buzzfeed Recht, uns darauf hinzuweisen, dass überzeugende Deepfake-Videos „schneller einfacher, billiger und allgegenwärtiger werden, als man denkt“ und dass „ein Zeitalter allgegenwärtiger Deepfakes eine ‚Infokalypse‘ einläuten könnte“.

Sie sind immer noch nicht beunruhigt? Das sollten Sie aber sein. Ich wage zu behaupten, dass Sie bereits irgendwann einmal von einem Deepfake-Video getäuscht wurden, und die Zukunft wird wahrscheinlich so aussehen, dass keine digitale Bild-, Video- oder Audiodatei mehr für bare Münze genommen werden kann.

Sie glauben mir nicht? Dann lade ich Sie ein, den folgenden Test zu machen . . .

Die Herausforderung

Sehen wir uns drei aktuelle Videos an. Ihre Aufgabe ist es, mir zu sagen, welche dieser Videos echt sind und welche von KI generierte Fälschungen sind. Sind Sie bereit?

Hier ist das erste Video:

Und hier ist das Zweite:

Und hier ist das Dritte:

OK, jetzt nicht schummeln. Ohne weiterzulesen, sag mir, welche dieser Videos deiner Meinung nach echt sind und welche von KI generierte Fälschungen sind.

Los, ich warte, bis du dich angemeldet hast und deine Vermutung in den Kommentaren zu diesem Beitrag dort hinterlässt. . . ..

. . OK, das sollte genug Zeit gewesen sein.

Also, hast du deine Vermutungen gemacht? Super! Ich auch!

Und möchtest du die richtige Antwort wissen? Super! Ich auch!

Die Ergebnisse

Wie Sie vielleicht wissen oder auch nicht, soll das erste Video ein Ausschnitt aus einer Rede des Präsidenten von Burkina Faso, Ibrahim Traoré, in englischer Sprache sein. Das Video trägt den Titel „Rede vor dem IWF“, und wenn nach mehr als zehn Sekunden kein Alarmglöckchen in Ihrem Kopf läutet, sollten Sie vielleicht die Batterien Ihres „FAKE VIDEO!“-Alarms austauschen.

Während des gesamten fast 30-minütigen Videos macht Traoré immer und immer und immer und immer und immer und immer und immer und immer und immer und immer und immer dieselbe Kopfbewegung von links nach rechts und von rechts nach links. (Scrollen Sie wirklich durch das gesamte Video, um zu sehen, wie lächerlich das ist.

Das Mikrofon vor seinem Gesicht verschwindet immer wieder zur Hälfte.

Und das Publikum hinter ihm löst sich immer wieder in einem seltsamen, seligen Licht auf, bevor es sich wieder materialisiert (offenbar unbeschadet).

Und natürlich fällt es schwer, die seltsame, abgehackte Art von Traorés Sprachmelodie zu übersehen, bei der einige Sätze plötzlich auf unnatürliche Weise abbrechen.

Sobald man darauf aufmerksam gemacht wird, merkt man, dass hier etwas „nicht stimmt”. Dieses eindeutig manipulierte Video wurde jedoch an zahlreichen Stellen im Internet als angeblich echte Rede gepostet und mir sogar von einem wohlmeinenden Zuhörer weitergeleitet, der ernsthaft bemerkte: „Ich habe seit langem nicht mehr so viel Mut, Klarheit und Einsicht von einem afrikanischen Staatschef gehört.”

Eine oberflächliche Recherche ergibt, dass es keine seriöse Nachrichtenagentur oder unabhängige Quelle gibt, die diese weltbewegende Rede aufgezeichnet oder eine Abschrift oder ein Zitat daraus veröffentlicht hat. Das Video taucht nur auf zufälligen YouTube-Kanälen und in obskuren Facebook-Posts auf.

Kurz gesagt, es handelt sich hier eindeutig um eine Fälschung, auch wenn weitere Recherchen notwendig wären, um die genaue Herkunft dieser manipulierten Rede zu bestimmen.

Wie sieht es nun mit dem zweiten Video aus?

Dieses Video gibt vor, die Audioaufnahme der „Dead Man’s Switch“-Botschaft von Virginia Giuffre zu enthalten. Wie meine sachkundigen Leser zweifellos wissen, war Virginia Giuffre eine der bekanntesten Opfer von Jeffrey Epstein und hat – wie ich mit dem erfahrenen Epstein-Forscher und Autor Nick Bryant besprochen habe – im vergangenen April Selbstmord begangen (oder „Selbstmord begangen“, je nachdem, was man glaubt). Die Audioaufnahme aus dem Video soll eine Nachricht sein, die sie aufgenommen hat und die nach ihrem Tod automatisch veröffentlicht werden sollte und in der sie all das offenbaren würde, was sie zu Lebzeiten nicht sagen konnte.

Die Informationen, die diese Audiobotschaft enthält, sind zweifellos schockierend: Epstein lebt. Zu den prominenten Besuchern von Epsteins „Pädophileninsel“ gehörten Barack Obama, George Clooney und Tom Hanks. Bill Gates führte dort widerwärtige genetische Experimente an Kindern durch.

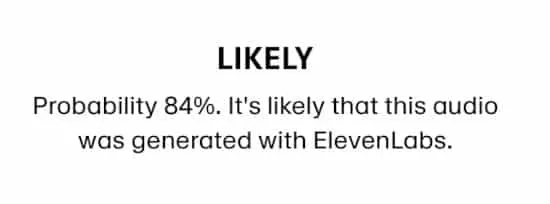

Aber ist die Botschaft echt? Klingt diese Stimme für Sie wie eine echte menschliche Stimme oder wie eine computergenerierte KI-Deepfake?

Ich habe kaum Zweifel daran, dass dies keine echte menschliche Stimme ist, aber wenn sie für Sie wie eine klingt, was könnte ich Ihnen sagen, um Sie davon zu überzeugen, dass es keine ist? Was könnten Sie mir sagen, um mich davon zu überzeugen, dass es eine ist?

Natürlich gibt es forensische Analysen … aber „forensische Analyse” bedeutet in diesem Fall, dass man die Stimme durch einen sogenannten „KI-Stimmdetektor” auf einer dubiosen Website laufen lässt, der einen „KI-Stimmdetektionsprozess” verwendet, der völlig undurchsichtig ist und selbst auf KI-Technologie basiert. Anstatt die Frage zu beantworten, ob eine Stimme authentisch menschlich oder KI-generiert ist, tragen diese „Deepfake-Detektoren“ nur eine weitere Ebene der Unsicherheit in die Debatte ein.

Was es auch wert sein mag, „AI Voice Sensor“ gibt an, dass diese Audioaufnahme „mit 100 %iger Wahrscheinlichkeit eine echte menschliche Stimme“ ist (die Quote gefällt mir!).

Der „AI Speech Classifier“ von ElevenLabs hingegen bewertet die Wahrscheinlichkeit, dass der Audioclip mit den KI-Audio-Tools von ElevenLabs erstellt wurde, mit 84 %:

Mit anderen Worten: Was auch immer Sie über diese Audioaufnahme glauben möchten, Sie können nun auf eine vermeintlich objektive Analyse verweisen, die Ihre Intuition bestätigt! Großartig!

Na gut, wie sieht es dann mit dem dritten Video aus? Können wir feststellen, ob dieses echt oder gefälscht ist?

Glücklicherweise haben wir endlich ein Video gefunden, dessen Echtheit (oder Unechtheit) nicht umstritten ist!

Es handelt sich um die Rede, die der argentinische Präsident Javier Milei auf dem Weltwirtschaftsforum in Davos im Januar 2024 gehalten hat. Hier ist das Video der tatsächlichen Rede: „La conferencia completa de Javier Milei En Davos”.

Die Rede wurde von Heygen, einem KI-Videogenerator mit KI-Übersetzungsfunktionen, ins Englische übersetzt. Heygen übersetzt nicht einfach die Worte eines beliebigen Redners in einem beliebigen Video. Es generiert nicht nur eine KI-Stimme, die die übersetzten Worte ausspricht. Es rendert diese Stimme im Stil der Stimme des Redners und synchronisiert dann automatisch die Lippenbewegungen im Video mit der KI-generierten Stimme.

Mit anderen Worten: Sie sehen Mileis spanische Rede auf Englisch, als würde sie von Javier Milei selbst auf Englisch gehalten.

Es ist nicht schwer zu verstehen, warum diese Technologie die Menschen damals so begeistert hat. Das Video wurde millionenfach online angesehen und sorgte für zahlreiche Schlagzeilen. Schließlich hat diese Technologie das Potenzial, die Sprachbarrieren zwischen Menschen ein für alle Mal zu beseitigen … vorausgesetzt natürlich, dass sie über die entsprechende Technologie miteinander kommunizieren.

Die Büchse der Pandora ist geöffnet. Aber was bedeutet das?

Was es bedeutet

Es braucht nicht viel Fantasie, um zu erkennen, wie diese Art von KI-Deepfake-Stimmklon-/Autotranslation-/Lippensynchronisationstechnologie zu bemerkenswerten Durchbrüchen führen und die Welt zum Besseren verändern könnte.

In „AI just changed the world. Again” untersucht Sean Thomas von The Spectator, wie diese Technologie in naher Zukunft unsere Welt verändern könnte:

Vermutlich wird diese Software bald mit Brillen oder Kontaktlinsen verbunden sein, die diese Aufgabe [Übersetzung und Lippensynchronisation] automatisch ausführen, und Sie müssen dann in Pisa, Lima oder Osaka nur noch diese Brille aufsetzen, um zu verstehen, was alle sagen, und ihre Mimik zu lesen, fast so, als wären Sie dort geboren. Wir könnten diese Brillen „Babel Glasses” nennen, zu Ehren von Douglas Adams‘ sofortigem Universalübersetzer, dem Babel Fish, da es eine auffällige Ähnlichkeit gibt. Der Hauptunterschied besteht darin, dass die Babel Glasses aufgrund der Lippensynchronisation viel besser sein werden als der Babel Fish.

Andererseits braucht es nicht viel Fantasie, um zu erkennen, wie diese Technologie dazu genutzt werden könnte, das Vertrauensfundament zu untergraben, auf dem unsere Zivilisation aufgebaut ist.

Hat Virginia Giuffre Selbstmord begangen oder wurde sie ermordet? Hat sie eine letzte Botschaft aufgezeichnet, in der sie all die brisanten Informationen preisgibt, die sie zu Lebzeiten nicht offenbart hat? Wurde diese Aufzeichnung von einer einzigen Nachrichtenseite auf noch unbekannte Weise beschafft und korrekt wiedergegeben?

Die Antworten auf diese Fragen sind natürlich unglaublich wichtig und potenziell politisch brisant. Stellen Sie sich nun aber vor, dass die Frage nach der Echtheit einer Audio- oder Videodatei zur Norm für jedes brisante Audio- oder Videomaterial wird, über das von nun an berichtet wird.

Anders ausgedrückt: Stellen Sie sich eine Welt vor, in der jeder nicht nur gezwungen ist, die politische Ausrichtung dieses oder jenes Reporters zu hinterfragen oder darüber nachzudenken, welche Informationen in einem Bericht möglicherweise ausgelassen wurden, sondern auch gezwungen ist, jede einzelne Audio- oder Videoaussage und jedes einzelne Dokument zu jedem einzelnen Ereignis, über das in Zukunft jemals berichtet wird, in Frage zu stellen.

Das ist die Welt, in die wir bald eintauchen werden.

Und so schlimm die Lage auch ist, sie verschlechtert sich von Tag zu Tag. Corbett Reporteers sind bereits mit Veo3 in Berührung gekommen, dem neuesten KI-Modell zur Videogenerierung, mit dem die hyperrealistischen Videos produziert wurden, die meinen letzten Podcast „We Need To Talk About AI” eröffnet haben.

Angesichts der rasanten Fortschritte, die die KI-Text-zu-Video-Generierung allein in den letzten drei Jahren gemacht hat, ist es fast sicher, dass KI-generierte Videos in wenigen Jahren nicht mehr von der Realität zu unterscheiden sein werden. Stellen Sie sich dann die mögliche Veröffentlichung von Erpressungsvideos von Epstein vor. Egal, wie belastend diese Videos für den Politiker, Geschäftsmann oder Finanzier sind, der darin zu sehen ist, sie werden nun die plausible Ausrede haben, dass es sich um KI-generierte Videos handelt.

Natürlich würden sie so etwas niemals tun, und wie können Sie es wagen, solche Beweise für bare Münze zu nehmen!

Die Anhänger des Angeklagten werden sich natürlich gerne auf diese Ausrede einlassen und ihn von jeglicher Schuld freisprechen. Seine Kritiker werden sich weigern zu glauben, dass das Filmmaterial nicht echt ist. Es werden verschiedene „Deepfake-Erkennungstechnologien“ zum Einsatz kommen, die wahrscheinlich widersprüchliche Ergebnisse liefern werden, wie im obigen Beispiel von Giuffre.

Nun werden die Menschen nicht mehr über die Interpretation von Fakten streiten. Sie werden keine Ideologien oder Weltanschauungen mehr diskutieren. Sie werden sich über die Dokumentation der Realität selbst streiten. Was ist passiert, und wie können wir jemals beweisen, dass es passiert ist?

Und es ist unwahrscheinlich, dass sich ein oder zwei hochkarätige Skandale in Zukunft so entwickeln werden. Jedes bedeutende Ereignis wird nun mit Reportern einhergehen, die die zusätzliche Last tragen, zu beweisen, dass es überhaupt stattgefunden hat.

Wir verlieren offiziell unser Verständnis der Realität selbst.

Die Lösung

Was ist also die Lösung für diese schwierige Situation?

Wie üblich schreiten die Regierungen ein, um zu versuchen, die Situation zu „reparieren“. Und wie üblich bedeutet diese „Reparatur“ der Regierung nicht „wiederherstellen“ oder „verbessern“, sondern „manipulieren“.

Ein Beispiel dafür ist ein Gesetzentwurf, der derzeit im US-Senat beraten wird und als „NO FAKES Act of 2025” bekannt ist. Laut einer Pressemitteilung eines der Kongressabgeordneten, die den Gesetzentwurf mitinitiiert haben, schützt der NO FAKES Act „die Stimme und das Abbild aller Personen vor unbefugten, computergenerierten Nachbildungen durch generative künstliche Intelligenz (KI) und andere Technologien”, indem er „ein klares Recht auf Kontrolle über digitale Nachbildungen der eigenen Stimme und des eigenen Bildes” festlegt.

Wie jedoch ein Konsortium von Interessenverbänden und Handelsgruppen, die sich gegen den Gesetzentwurf aussprechen, in einem offenen Brief zum NO FAKES Act hervorhebt, handelt es sich hierbei um einen juristischen Trick. Durch den Versuch, ein Eigentumsrecht an der digitalen Abbildung einer Person zu schaffen, anstatt ein Recht auf Privatsphäre bei der Verwendung der eigenen Abbildung, wurde der Gesetzentwurf in irreführender Weise so konzipiert, dass er die Verbreitung dieser KI-Deepfakes nicht stoppt, sondern tatsächlich einen legalen Markt für KI-Darstellungen realer Personen schafft.

Ein digitales Replikatrecht, das ohne wesentliche Einschränkungen lizenziert oder übertragen werden kann, gefährdet die Freiheit und Autonomie der vorgesehenen Begünstigten dieses Rechts. NO FAKES enthält zwar einige Einschränkungen hinsichtlich der Lizenzierung und Übertragung, lässt jedoch weiterhin Raum für Missbrauch. Die Anforderung einer „schriftlichen Unterzeichnung” und einer „angemessen spezifischen Beschreibung der beabsichtigten Verwendungszwecke” einer Replik lässt weiterhin die Möglichkeit offen, durch eine einfache Klick-Lizenz ein exklusives 10-jähriges Recht zu erwerben, unbegrenzt viele Tonaufnahmen oder audiovisuelle Werke zu erstellen, die einer bestimmten Beschreibung entsprechen. Sowohl professionelle Darsteller als auch Privatpersonen könnten bis zu einem Jahrzehnt lang von ihrem eigenen Abbild ausgeschlossen sein und keine Werke schaffen oder deren Schaffung genehmigen, die ihre digitale Replik enthalten. Gleichzeitig würde nichts in dem Gesetzentwurf einen lizenzierten Nutzer daran hindern, eine digitale Replik zu verwenden, um Falschinformationen zu verbreiten, darunter Videos, die Personen zeigen, die Dinge tun oder sagen, die sie nie getan oder gesagt haben, ohne dass offen gelegt wird, dass es sich um synthetische Darstellungen handelt.

Das NO FAKES-Gesetz ist jedoch nur eine rechtliche Antwort auf einen Aspekt eines Problems, das durch das Phänomen der KI-Deepfakes aufgeworfen wurde, und es gilt nur für ein Land. In den kommenden Jahren werden zweifellos viele weitere Gesetzesentwürfe ihren Weg durch die verschiedenen Gesetzgebungsorgane rund um den Globus finden, aber keiner davon wird das Problem an der Wurzel packen.

Diese Technologie existiert nun einmal. Die Zahnpasta ist aus der Tube. Und keine Gesetzgebung wird Geheimdienste und andere Akteure des Deep State (ganz zu schweigen von gewöhnlichen Kriminellen und Unruhestiftern) daran hindern, sie in Zukunft zu nutzen.

Es wird seit langem berichtet, dass CIA-Direktor William Casey während einer Sitzung im Februar 1981 im Roosevelt Room im Westflügel des Weißen Hauses sagte: „Wir werden wissen, dass unser Desinformationsprogramm abgeschlossen ist, wenn alles, was die amerikanische Öffentlichkeit glaubt, falsch ist.“

Aber so erschreckend diese CIA-Mission auch ist, das Deepfake-Phänomen lässt etwas viel Schlimmeres befürchten. Wenn diese Technologie immer weiter verbreitet wird, wird nicht alles, was die amerikanische Öffentlichkeit (oder die Weltöffentlichkeit) glaubt, falsch sein. Es wird vielmehr so sein, dass niemand mehr definitiv beweisen kann, was wahr ist und was nicht. Die Realität selbst wird im digitalen Äther verschwinden.

Wie könnte es noch schlimmer kommen?

Wie wäre es mit dieser Nachricht: YouTube fügt jetzt einen KI-Slop-Button hinzu, mit dem Nutzer auf Knopfdruck automatisch kurze Videos mit KI-Technologie von Veo3 generieren können. Und Sie können davon ausgehen, dass die anderen Big-Tech-Unternehmen nicht lange auf sich warten lassen werden. Gott stehe uns allen bei.

In der Zwischenzeit könnten Sie doch einmal die „Spot The Deepfake“-Challenge an Ihre Bekannten weitergeben. Wir brauchen zumindest mehr Menschen, die sich mit der dunklen Realität der Welt, in die wir eintreten, auseinandersetzen, bevor diese Realität für immer verschwindet.